Avec l'IA, on n'a plus besoin de mémoire. Vraiment?

Avec l'IA, on n'aurait plus besoin de mémoire? C'est exactement l'inverse. Ce qu'on n'a pas encodé, on ne peut ni l'évaluer, ni l'utiliser au bon moment. Pourquoi la mémoire sélective et la pensée critique deviennent encore plus critiques à l'ère de l'IA, et ce que ça change pour la formation.

On voit passer le message partout en ce moment. Sur LinkedIn, dans les conférences, dans les fils de discussion entre professionnels. L'idée est séduisante : pourquoi mémoriser quoi que ce soit quand l'IA peut nous donner la réponse en trois secondes?

Je pense que c'est exactement l'inverse.

Plus l'information devient accessible instantanément, plus la capacité humaine de juger, filtrer et appliquer cette information au bon moment devient rare. Ce qu'on n'a pas encodé en mémoire, on ne peut pas l'évaluer, le remettre en question, ni l'utiliser quand ça compte. L'IA peut nous donner une réponse. Mais si on n'a pas les bases en mémoire, on ne sait même pas quelle question poser.

Le vrai enjeu n'est pas de tout retenir

On peut évacuer tout de suite le faux débat. L'enjeu n'est pas de tout apprendre par cœur. La question n'a jamais été là. La question, c'est : qu'est-ce qui mérite d'être encodé en profondeur, et qu'est-ce qu'on peut raisonnablement déléguer à un outil, que cet outil soit une checklist, un guide de référence ou un modèle d'IA?

C'est une question de conception, pas de nostalgie.

En conception pédagogique, on utilise des grilles d'arbitrage pour faire cette distinction. Le filtre E-MAD, par exemple, fait passer chaque contenu à travers quatre questions séquentielles : est-ce que cette information déclenche une décision? Est-ce qu'elle est utilisée fréquemment? Quel est le coût si on l'oublie? Et surtout, est-il réaliste de consulter une aide au moment où on en a besoin?

Quand un chirurgien est en salle d'opération, il ne peut pas ouvrir ChatGPT pour vérifier une étape critique. Quand un gestionnaire doit recadrer un employé en temps réel, il n'a pas le luxe de consulter un guide. Ce qui doit sortir de la tête rapidement et correctement au moment où la situation se présente, ça, c'est de la mémoire qui compte. Le reste peut vivre dans un support externe, à condition que ce support soit bien conçu et qu'on ait appris à s'en servir.

L'IA ne change pas cette logique. Elle la rend plus urgente.

La pensée critique a besoin d'une base en mémoire

C'est le point que les discours enthousiastes sur l'IA escamotent systématiquement. La pensée critique n'est pas une compétence abstraite qu'on peut exercer dans le vide. Elle s'appuie sur des connaissances structurées en mémoire à long terme. Daniel Willingham l'a résumé simplement : on ne peut pas penser de manière critique à propos de quelque chose qu'on ne connaît pas. Pas parce qu'on manque d'intelligence, mais parce que le raisonnement critique a besoin de matériau.

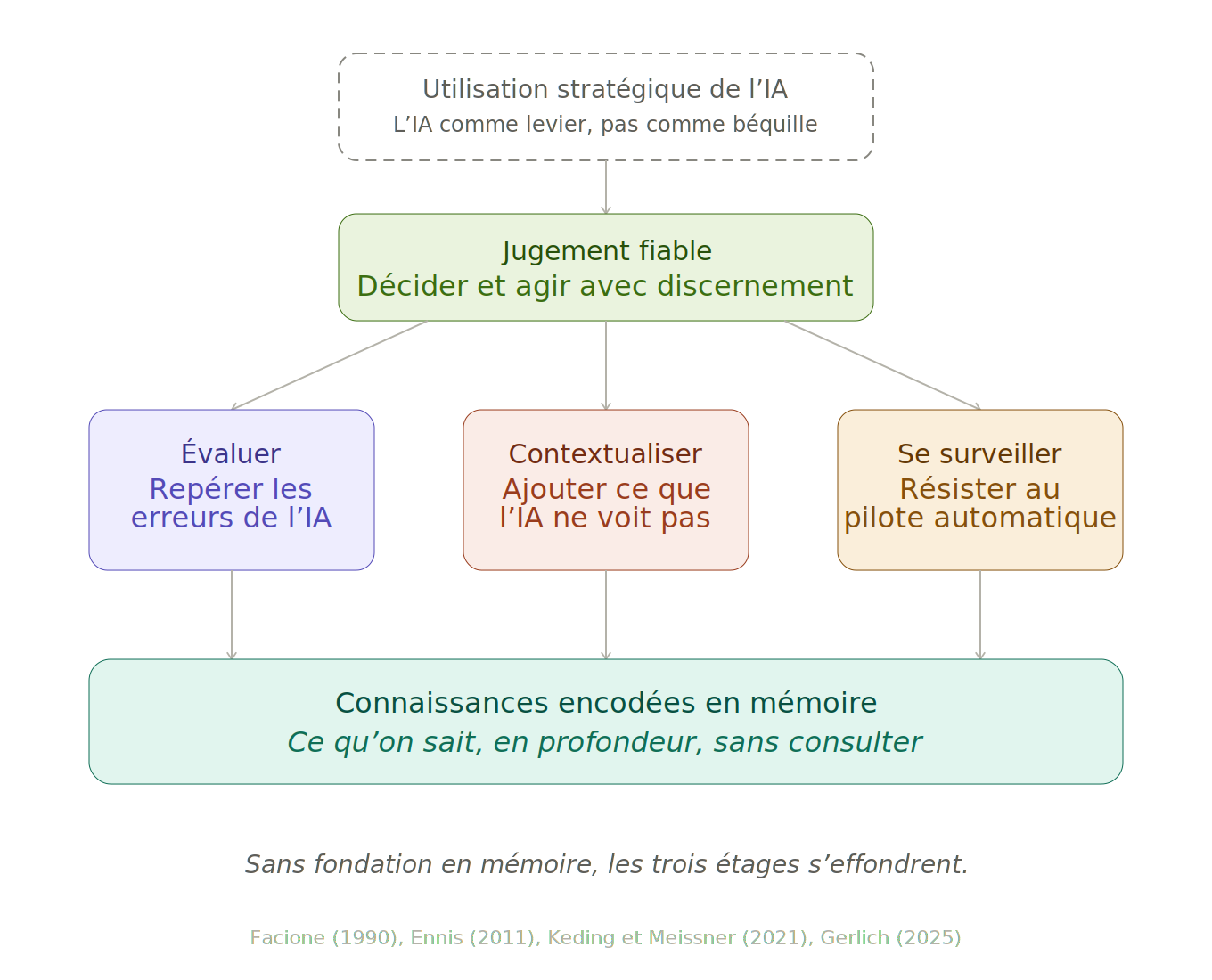

Et quand on regarde ce que la pensée critique exige concrètement face à l'IA, on comprend vite pourquoi la mémoire est non négociable. La recherche en sciences cognitives identifie trois capacités interdépendantes, et chacune dépend directement de ce qu'on a en mémoire.

D'abord, il y a la capacité d'évaluer ce que l'IA produit. Ne pas accepter au premier regard. Questionner la pertinence, repérer les limites, détecter quand la machine a l'air d'avoir raison mais se trompe. Pour ça, il faut des repères internes. Quelqu'un qui n'a rien encodé dans le domaine prend une réponse approximative pour argent comptant. Il n'a pas les schémas mentaux pour détecter l'écart. Et la recherche montre que c'est exactement ce qui se passe : les gestionnaires suivent les recommandations de l'IA davantage que celles d'experts humains, même quand ils ne devraient pas. Sans base en mémoire, la déférence envers la machine devient automatique.

Ensuite, il y a la capacité de contextualiser, d'ajouter ce que l'IA ne voit pas. L'IA n'a pas accès à la culture d'une équipe, à l'historique relationnel avec un client, aux implications éthiques d'une décision dans un contexte précis. La pensée critique est fondamentalement centrée sur la décision de quoi croire ou faire en contexte. Ce contexte, il vit dans la tête de la personne qui décide. S'il n'a pas été encodé, il ne peut pas être intégré à la décision. Et l'IA ne le fera pas à notre place.

Et puis il y a la capacité de se surveiller soi-même, de penser sa propre pensée. Reconnaître ses biais, ses raccourcis mentaux, et surtout sa tendance à réduire l'effort cognitif quand l'IA peut le faire à notre place. Les chercheurs appellent ça le cognitive offloading : on délègue graduellement à la machine non seulement les tâches, mais le travail de réflexion lui-même. Une étude récente de Microsoft Research, menée auprès de 319 travailleurs, confirme que plus la confiance envers l'IA est élevée, plus la vigilance critique diminue. On arrête de vérifier. On arrête de douter. On arrête de penser.

Il y a un point souvent invisible là-dedans. La pensée critique n'est pas seulement une capacité. C'est aussi une disposition, une tendance à exercer son jugement même quand c'est plus facile de ne pas le faire. On peut posséder les habiletés sans jamais les utiliser si la disposition n'est pas là. À l'ère de l'IA, où l'effort de vérification est en concurrence directe avec le confort de la réponse instantanée, cette disposition devient le vrai facteur différenciateur.

Le mécanisme fondamental ne change pas avec l'IA. Il devient plus critique. Parce que le volume de contenu généré explose, et que la capacité de tri humaine n'a pas changé. Celui qui a des bases solides et la disposition à les utiliser se sert de l'IA comme d'un levier puissant. Celui qui n'a ni l'un ni l'autre se retrouve submergé par du contenu qu'il ne peut ni évaluer, ni contextualiser, ni hiérarchiser.

Ce que ça change pour la formation

Si la mémoire sélective est plus importante que jamais, alors la façon dont on évalue l'apprentissage doit suivre. Et c'est là qu'on a un problème.

La majorité des organisations mesurent encore leurs formations avec des sondages de satisfaction en fin de séance. Et on prend ces résultats pour une validation que les gens ont appris. Le modèle LTEM de Will Thalheimer met le doigt sur une distinction que la plupart des gens ignorent : tester quelqu'un le jour même de la formation, ça mesure la compréhension. Tester trois jours plus tard ou davantage, ça mesure la rétention. Ce n'est pas la même chose. Et seule la rétention nous dit si quelque chose a réellement été encodé.

Si la mémoire sélective est devenue un avantage concurrentiel à l'ère de l'IA, mesurer uniquement la compréhension immédiate, ou pire la satisfaction, ne suffit plus. On a besoin de savoir ce qui a été retenu, ce qui est transféré au travail, et ce qui influence réellement les décisions des gens.

Le paradoxe de l'IA

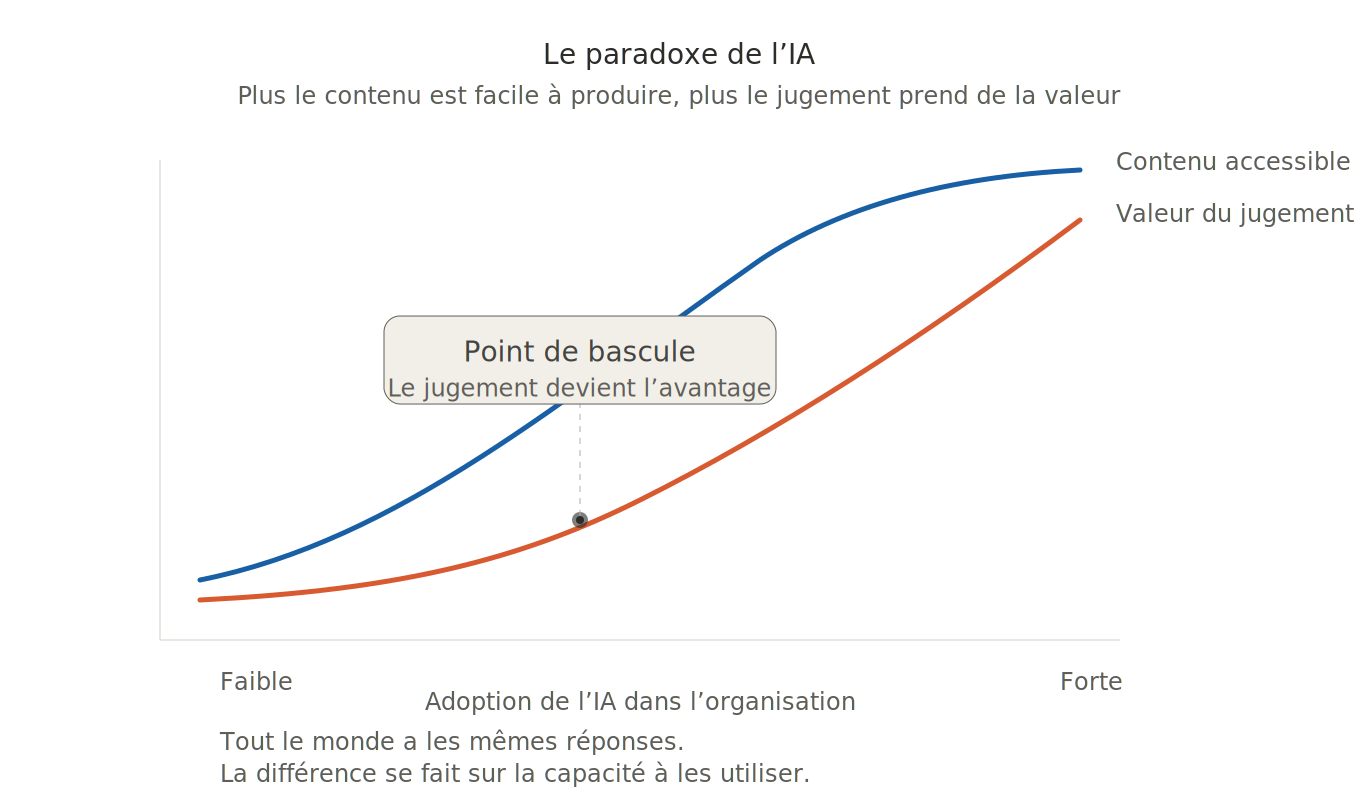

On arrive à un paradoxe intéressant. Plus l'IA rend le contenu facile à produire, plus la capacité humaine de juger ce contenu devient rare et précieuse. Plus tout le monde a accès aux mêmes réponses instantanées, plus la différence se fait sur la profondeur de compréhension qui permet de poser les bonnes questions, de repérer les failles, et d'agir avec discernement.

La rétention humaine n'est pas une relique de l'ancien monde. C'est ce qui sépare quelqu'un qui utilise l'IA de manière stratégique de quelqu'un qui en dépend passivement.

Et c'est exactement la raison pour laquelle on ne peut pas se contenter de former les gens et de croiser les doigts. La conception doit viser la rétention : pratique de récupération, espacement, scénarios réalistes. La mesure doit dépasser la satisfaction du jour même pour aller chercher la capacité réelle à décider et agir des semaines plus tard. Et on doit accepter que tout ne mérite pas d'être mémorisé, mais que ce qui le mérite doit être traité avec le sérieux que ça demande.

À l'ère de l'IA, la mémoire ne devient pas moins utile. Elle devient plus stratégique. Et si on ne conçoit pas nos formations en conséquence, on prépare des professionnels qui auront accès à tous les outils du monde, sans le jugement nécessaire pour s'en servir.